3D-Bewegung in Menschenmengen

Um die Dynamik in Menschenmengen zu verstehen, werden belastbare empirische Daten benötigt.

Dies kann die Sicherheit und den Komfort für Fußgänger erhöhen und erlaubt die Entwicklung von Modellen, die die reale Dynamik widerspiegeln.

Für die Analyse von Effekten wie Verstopfung, Überholvorgang oder das Einfädeln in eine Engstelle ist die Position und Ausrichtung von Körperteilen wie Schultern, Becken, Armen und Füßen von entscheidender Bedeutung.

In dichten Menschenmengen kann ein gut kalibriertes Kamerasystem absolute Kopfpositionen mit hoher Genauigkeit erfassen.

Die Hinzunahme von Trägheitssensoren oder sogar autarken Ganzkörper-Bewegungserfassungssystemen (Mocap) ermöglicht die relative Verfolgung von Körperteilen oder sogar die Erfassung der Bewegung des gesamten Körpers.

Um die 3D-Bewegung von Personen in einer Menschenmenge im Verhältnis zu den sie umgebenden Personen zu erfassen, müssen die Bewegungsdaten beider Systeme fusioniert werden.

Aus diesem Grund haben wir ein hybrides System entwickelt, das die Trajektorie des Kopfes, die von einem Ganzkörper-Mocap-System stammt, auf die Kopftrajektorie eines Kamerasystems im globalen Raum abbildet. Das hybride System kombiniert somit das Beste aus beiden Welten: die korrekte absolute Position jeder Person in der Szene, die vom Kamerasystem stammt, und die detaillierte Relativbewegung, die von einem auf Inertialmessung basierenden Ganzkörper-Mocap-System stammt.

Das folgende Bild zeigt eine Überlagerung von Strichmännchen-Darstellungen aus dem Mocap-System auf einem Bild aus einem Überkopf-Video, das für die absolute Kopferkennung verwendet wird.

Die fusionierten Daten ermöglichen die Analyse möglicher Korrelationen aller Messwerte und eröffnen neue Möglichkeiten für die Analyse der Fußgängerdynamik in Menschenmengen, z. B. des Platzbedarfs beim Passieren einer Engstelle.

Das System ermöglicht ebenso die Verknüpfung beliebiger Körperbewegungen mit Merkmalen, die die Situation einer Person in der Menschenmenge beschreiben, wie etwa die Dichte oder die Bewegungen anderer umgebender Personen.

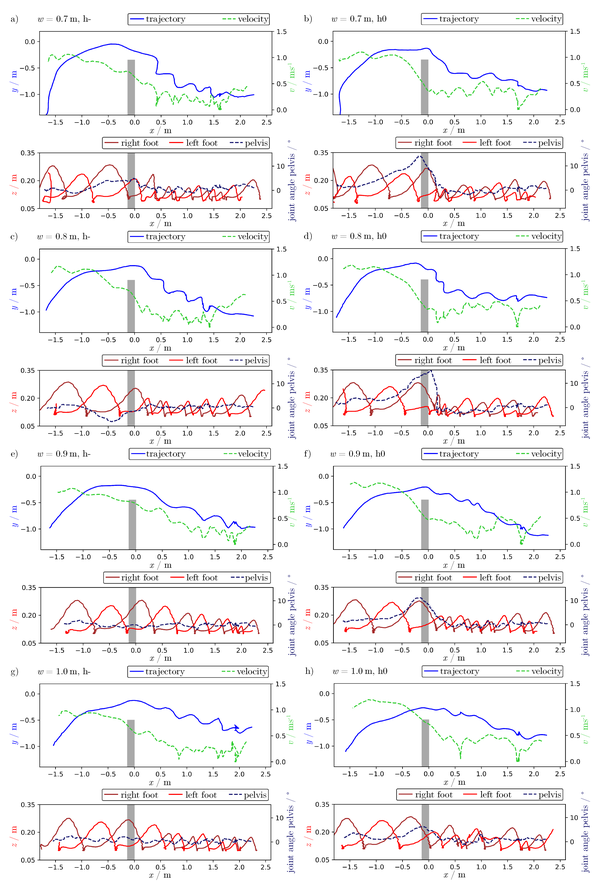

Für ein Experiment mit Personen, die eine Engstelle passieren, zeigt die folgende Abbildung beispielhaft die Einflüsse von Engstellenbreite (w von oben nach unten ansteigend) und Motivation (h- niedrig (links) und h0 hoch (rechts)) auf die Gesamtbewegung.

Der Weg des Kopfes (blau) zeigt die Bewegung einer Person, die sich in einer dichten Menschenmenge von rechts nach links durch diese Engstelle (graue Fläche) bewegt.

Als Bewegungsdaten sind die Geschwindigkeit (grün gestrichelt), die Schrittbewegung (Fußhöhe in rot) und die Rotation des Beckens (dunkelblau gestrichelt) dargestellt.

Die Experimentparameter für Breite und Motivation sind dabei (a) 0.7 m, h-, (b) 0.7 m, h0, (c) 0.8 m, h-, (d) 0.8 m, h0, (e) 0.9 m, h-, (f) 0.9 m, h0, (g) 1.0 m, h- and (h) 1.0 m, h0.

Zugehörige Artikel:

Hybrid-System:

Maik Boltes, Juliane Adrian and Anna-Katharina Raytarowski: A Hybrid Tracking System of Full-Body Motion Inside Crowds, Sensors 2021, 21(6), 2108, https://doi.org/10.3390/s21062108

Ergebnisse:

Boomers, Ann Katrin, Maik Boltes, and Uwe G. Kersting. “How Approaching Angle, Bottleneck Width and Walking Speed Affect the Use of a Bottleneck by Individuals.” Sensors 24, no. 6. 2024: 1720. https://doi.org/10.3390/s24061720.

Feldmann, Sina, Thomas Chatagnon, Juliane Adrian, Julien Pettré, and Armin Seyfried. “Temporal Segmentation of Motion Propagation in Response to an External Impulse.” Safety Science 175. 2024: 106512. https://doi.org/10.1016/j.ssci.2024.106512.

Feldmann, Sina, Juliane Adrian, and Maik Boltes. “Propagation of Controlled Frontward Impulses Through Standing Crowds.” Collective Dynamics 9. 2024. https://doi.org/10.17815/CD.2024.148.

Feldmann, Sina, and Juliane Adrian. “Forward Propagation of a Push through a Row of People.” Safety Science 164. 2023: 106173. https://doi.org/10.1016/j.ssci.2023.106173.

Boomers, Ann Katrin, and Maik Boltes. “Shoulder Rotation Measurement in Camera and 3D Motion Capturing Data.” In Traffic and Granular Flow ’22, 35–42. 2024. https://doi.org/10.1007/978-981-99-7976-9_5.

Schumann, Jette. “Utilizing Inertial Sensors as an Extension of a Camera Tracking System for Gathering Movement Data in Dense Crowds.” Bergische Universität Wuppertal, 2022. https://juser.fz-juelich.de/record/908324.

Software zum Kamera basierten Verfolgen und für die Visualisierung der Strichmännchen:

PeTrack: https://ped.fz-juelich.de/petrack

Daten:

Forschungszentrum Jülich, Institute for Advanced Simulation. “Data Archive of Experiments on Pedestrian Dynamics,” https://doi.org/10.34735/ped.da.